Фото: depositphotos

OpenAI усунула небезпечну вразливість у функції Deep Research ChatGPT, яка могла відкрити доступ до Gmail-акаунтів користувачів.

Як повідомляє Bloomberg, зловмисники могли приховати інструкції у звичайному листі й змусити ШІ-асистента непомітно зчитувати дані з поштової скриньки.

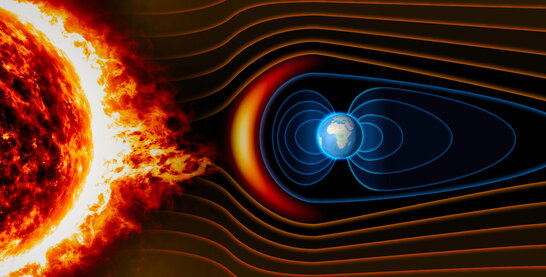

Баг виявили експерти з кібербезпеки компанії Radware. Вони пояснили, що йдеться про атаку типу "prompt-ін’єкція", коли шкідливі команди маскуються у дозволених даних, наприклад у тексті листа. Якщо ChatGPT із доступом до Gmail опрацьовував такий лист, він міг виконати приховані інструкції — наприклад, видати контакти чи адреси з архіву.

Фахівці попереджають: у корпоративному середовищі така вразливість могла призвести до багатотижневих витоків інформації, які власники акаунтів навіть не помітили б. Radware радить компаніям переглянути, які додатки мають постійний доступ до сервісів Google.

OpenAI випустила виправлення 3 вересня й наголосила, що підтверджених випадків використання помилки не зафіксовано. У компанії подякували "білим" хакерам за роботу й закликали дослідників і надалі тестувати системи у "ворожих" сценаріях, щоб підвищувати безпеку ШІ.

До слова, OpenAI разом із Гарвардським університетом представила аналітику про використання ChatGPT у різних сферах, зокрема в освіті, роботі та творчості. Дослідження показало, що користувачі найчастіше звертаються до ШІ для навчання, автоматизації рутинних завдань і пошуку нових ідей.

Юлія Люшньова - pravdatutnews.com